À retenir

Les élections nationales massives en Inde, qui ont reconduit le premier ministre Narendra Modi pour un troisième mandat consécutif historique, bien qu’avec un mandat affaibli, ont mis en lumière l’utilisation croissante des outils d’intelligence artificielle (IA) pour modifier la nature des campagnes politiques et amplifier l’engagement des électeurs. Si cette technologie permet aux partis d’atteindre un plus grand nombre d’électeurs, elle suscite également des inquiétudes quant à son utilisation abusive pour diffuser de la désinformation, une préoccupation motivée par la montée en puissance des médias synthétiques générés par l’IA, connus sous le nom de « hypertrucage ». L’impact de l’IA sur les élections indiennes est remarquable non seulement parce qu’il s’agit de la plus grande démocratie du monde, mais aussi parce qu’il pourrait préfigurer les défis auxquels d’autres démocraties, y compris le Canada, pourraient être confrontées.

En bref

- De nombreux candidats aux récentes élections en Inde ont utilisé des « avatars » créés par l’IA pour communiquer avec les citoyens individuels d’un électorat qui compte 968 millions d’électeurs inscrits. Ce type d’engagement « hyperpersonnalisé » est censé renforcer l’attrait politique des candidats en montrant aux électeurs qu’ils sont à l’écoute des préoccupations spécifiques de chacun d’entre eux.

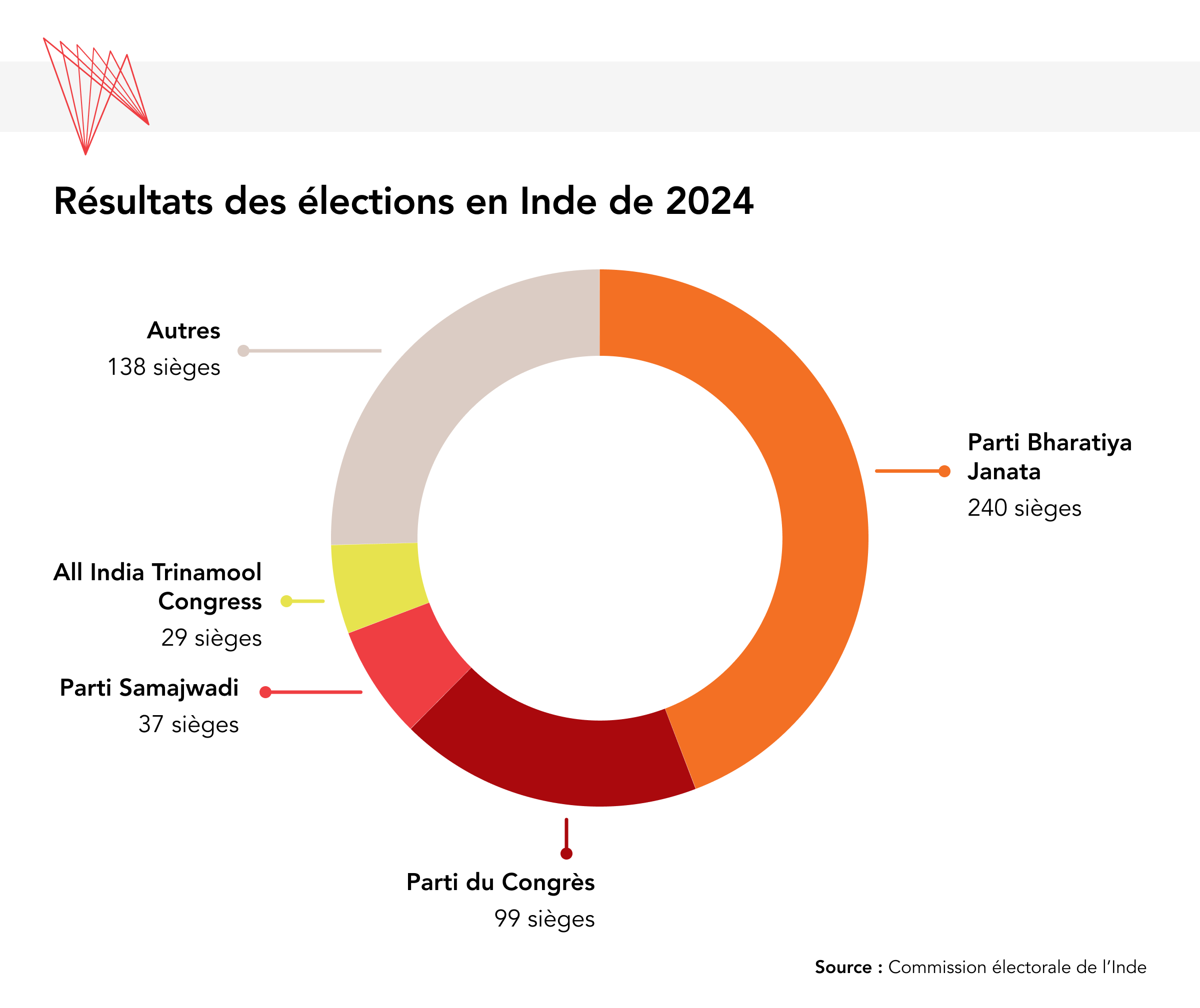

- Cependant, les deux plus grands partis nationaux — le Bharatiya Janata Party (BJP) au pouvoir et le Parti du Congrès dans l’opposition — se sont mutuellement accusés d’influencer injustement les électeurs en diffusant des « fausses nouvelles » par le biais de « hypertrucages », c’est-à-dire des sons, des images ou des vidéos manipulés numériquement.

- Parmi les exemples récents, citons les fausses vidéos de l’ancien ministre en chef du Tamil Nadu, M. Karunanidhi, aujourd’hui décédé, faisant l’éloge du leadership de son fils M.K. Stalin, l’actuel ministre en chef de l’État. Quelques célébrités de Bollywood ont porté plainte auprès de la police pour leur « présence » dans des « hypertrucages » vidéos virales circulant sur les médias sociaux. Ces vidéos contiennent régulièrement des messages électoraux trompeurs.

- Meta, la société mère de WhatsApp et de Facebook, aurait approuvé 14 publicités électorales générées par l’IA qui contenaient des propos suprémacistes hindous et appelaient au meurtre de musulmans et d’un important dirigeant de l’opposition alors que les élections étaient en cours. Certaines des vidéos contenaient la fausse affirmation selon laquelle le dirigeant « voulait effacer les hindous de l’Inde ».

- Bien que la commission électorale indienne ait publié le 6 mai un avis aux partis mettant en garde contre les « hypertrucages » générés par l’IA, l’approche généralement non interventionniste du gouvernement en matière de réglementation du domaine de l’IA s’étend à son éventuelle utilisation abusive dans le cadre des élections.

Implications

Les robots d’IA ne connaissent peut-être pas bien les dialectes locaux et sont susceptibles de faire des traductions inexactes, mais ils peuvent contribuer à atténuer les barrières linguistiques en permettant aux candidats d’atteindre davantage d’électeurs qui parlent l’une des nombreuses langues régionales de l’Inde. Cela pourrait accroître le soutien à des partis comme le BJP, généralement considéré comme un parti de locuteurs de l’hindi, parmi les électeurs du sud et de l’est qui ne parlent pas l’hindi. Modi, par exemple, a utilisé Bhashini, l’outil gouvernemental alimenté par l’IA, pour s’assurer que le public tamoul puisse entendre son discours, qui a été prononcé en hindi et traduit en tamoul en temps réel. Ses discours ont également été traduits en kannada, bengali, telugu, odia et malayalam, entre autres, grâce à l’IA. En outre, avant les élections, l’application officielle du premier ministre — NaMo — a lancé une fonctionnalité destinée à promouvoir plus largement les succès politiques du gouvernement grâce à des robots conversationnels alimentés par l’IA.

Les craintes que la désinformation n’entache le processus démocratique sont particulièrement importantes en Inde, où les médias sociaux et l’utilisation d’Internet sont très répandus. Le pays compte plus de 400 millions d’utilisateurs de WhatsApp – la plus grande base d’utilisateurs de l’application de messagerie au monde – et environ 820 millions d’utilisateurs actifs d’Internet. Plus de la moitié de ces utilisateurs résident dans des zones rurales, où la connaissance et la capacité à repérer les « hypertrucages » tendent à être encore plus faibles.

Bien que des entreprises telles que Meta se soient publiquement engagées à empêcher la diffusion de contenus manipulés générés par l’IA pendant les élections, ces contenus ont envahi les médias sociaux et les applications de messagerie. Si les inquiétudes concernant les contenus manipulés par l’IA ne sont pas particulièrement récentes, avec l’avènement d’outils d’IA sophistiqués, les contenus manipulés peuvent sembler remarquablement réels.

Prochaines étapes

1. Demande croissante de cadres réglementaires ?

Le 1er mars, le ministère indien des technologies de l’information a annoncé que les entreprises technologiques devaient obtenir l’autorisation du gouvernement avant de mettre leurs produits d’intelligence artificielle en ligne. Cette exigence fait suite aux réactions négatives à l’encontre de « Gemini », le robot conversationnel de Google alimenté par l’IA, pour sa réponse controversée lorsqu’on lui a demandé si les politiques de Modi étaient « fascistes ». La directive du ministère a suscité des inquiétudes quant à l’ingérence du gouvernement et à l’étouffement de l’innovation dans le domaine de l’IA, et le gouvernement s’est rétracté par le biais d’une autre directive le 15 mars.

La validité juridique des deux directives a fait l’objet d’un examen approfondi, car elles n’avaient pas force de loi et leur champ d’application et leurs effets n’étaient pas clairs. Les deux directives mettent en garde contre l'utilisation de modèles d’IA qui « menacent l’intégrité du processus électoral », même si les critères permettant de déterminer ces menaces ne sont pas clairs. Actuellement, l’Inde ne dispose d’aucune loi ou réglementation spécifique régissant directement l’IA. Conformément à l’approche généralement non interventionniste du gouvernement de l’Inde en matière de réglementation de l’IA, le ministre des Technologies de l’information Ashwini Vaishnaw a informé le parlement indien en 2023 que le gouvernement ne prévoyait pas de légiférer sur la question ou de réglementer la croissance de l’IA. Néanmoins, la recrudescence des « hypertrucages » pendant les élections pourrait renforcer la demande d’une réglementation plus stricte.

2. Défis mondiaux, préoccupations canadiennes

S’il n’existe pas encore de données fiables permettant de savoir si les outils d’IA perturbent l’intégrité des processus démocratiques, les élections en Inde peuvent laisser présager des tendances futures, notamment en raison de la taille, de l’échelle et de l’exposition numérique de ce pays. Le Canada, bien que classé premier parmi 80 pays dans un rapport de 2023 sur l’intelligence artificielle et les valeurs démocratiques, n’est pas à l’abri du « risque catastrophique » pour « la démocratie et la stabilité géopolitique » posé par les « hypertrucages » et les campagnes de désinformation. L’expérience de l’Inde pourrait servir d’étude de cas précieuse pour le Canada, qui se prépare pour les prochaines élections fédérales.

• Édité par : Ted Fraser, rédacteur principal, FAP Canada